Flume(一)【概述】

2021-01-26 05:12

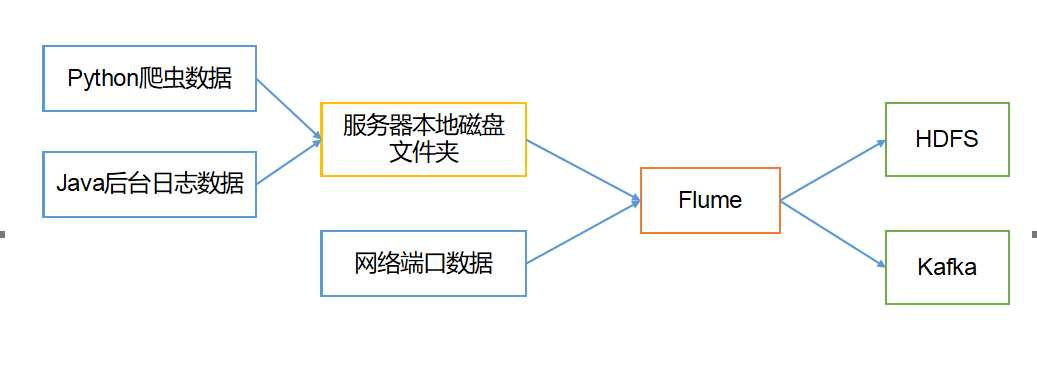

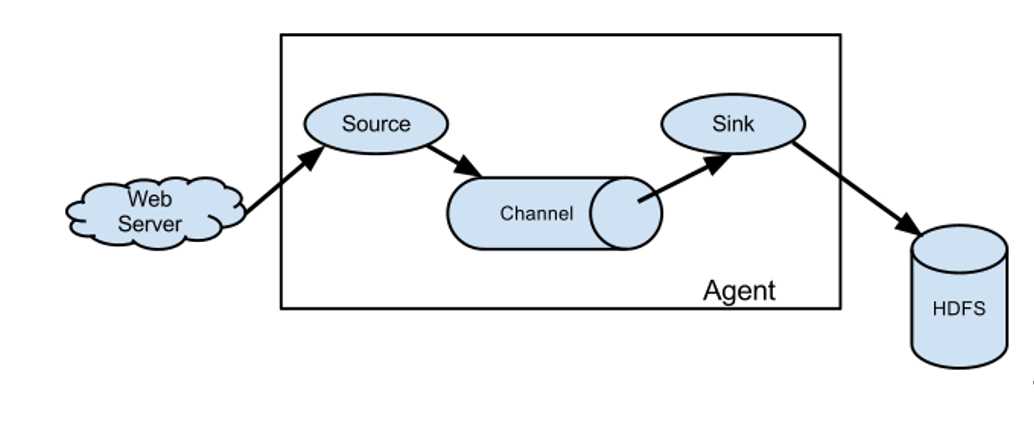

标签:需要 solr body hbase 本地磁盘 eve cat col 移除 ? Flume是Cloudera公司提供的一个高可用、高可靠、分布式的海量日志采集、聚合和传输的系统。Flume基于流式架构,灵活简单。 ? Flume最主要的作用就是,实时读取服务器的本地磁盘的数据,将数据写入到HDFS。 ? Flume基本组成架构如下图所示 ? 各个组件介绍 ? Agent是一个JVM进程,它以事件的形式将数据从源头送至目的。 ? Agent主要有3个部分组成:Source、Channel、Sink。 ? Source是负责接收数据到Flume Agent的组件。Source组件可以处理各种类型、各种格式的日志数据,包括avro、thrift、exec、jms、spooling directory、taildir、netcat、sequence generator、syslog、http、legacy。 taildir source 详解 ? Taildir Source维护了一个json格式的position File,其会定期的往position File中更新每个文件读取到的最新的位置,因此能够实现断点续传。Position File的格式如下: 注:Linux中储存文件元数据的区域就叫做inode,每个inode都有一个号码,操作系统用inode号码来识别不同的文件,Unix/Linux系统内部不使用文件名,而使用inode号码来识别文件。 ? Sink不断地轮询Channel中的事件且批量地移除它们,并将这些事件批量写入到存储或索引系统、或者被发送到另一个Flume Agent。 ? Sink组件目的地包括hdfs、logger、avro、thrift、ipc、file、hbase、solr、自定义。 ? Channel是位于Source和Sink之间的缓冲区。因此,Channel允许Source和Sink运作在不同的速率上。Channel是线程安全的,可以同时处理几个Source的写入操作和几个Sink的读取操作。 ? Flume自带两种Channel:Memory Channel和File Channel。 ? Memory Channel是内存中的队列。Memory Channel在不需要关心数据丢失的情景下适用。如果需要关心数据丢失,那么Memory Channel就不应该使用,因为程序死亡、机器宕机或者重启都会导致数据丢失。 ? File Channel将所有事件写到磁盘。因此在程序关闭或机器宕机的情况下不会丢失数据。 ? 传输单元,Flume数据传输的基本单元,以Event的形式将数据从源头送至目的地。Event由Header和Body两部分组成,Header用来存放该event的一些属性,为K-V结构,Body用来存放该条数据,形式为字节数组。 Flume(一)【概述】 标签:需要 solr body hbase 本地磁盘 eve cat col 移除 原文地址:https://www.cnblogs.com/wh984763176/p/13233063.html

一.Flume定义

二.Flume基础架构

1.Agent

2.Source

{"inode":2496272,"pos":12,"file":"/opt/module/flume/files/file1.txt"}

{"inode":2496275,"pos":12,"file":"/opt/module/flume/files/file2.txt"}

3.Sink

4.Channel

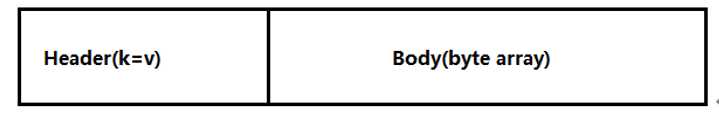

5.Event