部署一套完整的Kubernetes高可用集群(二进制,最新版v1.18)上

2021-02-13 01:17

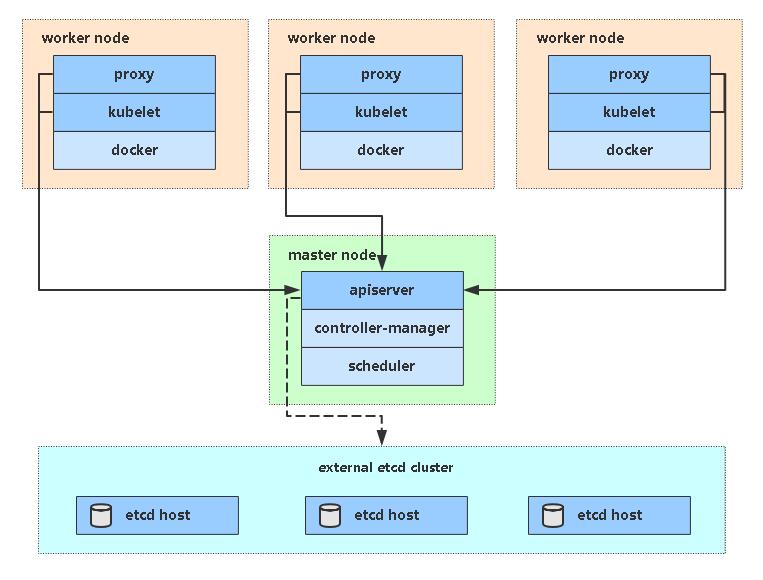

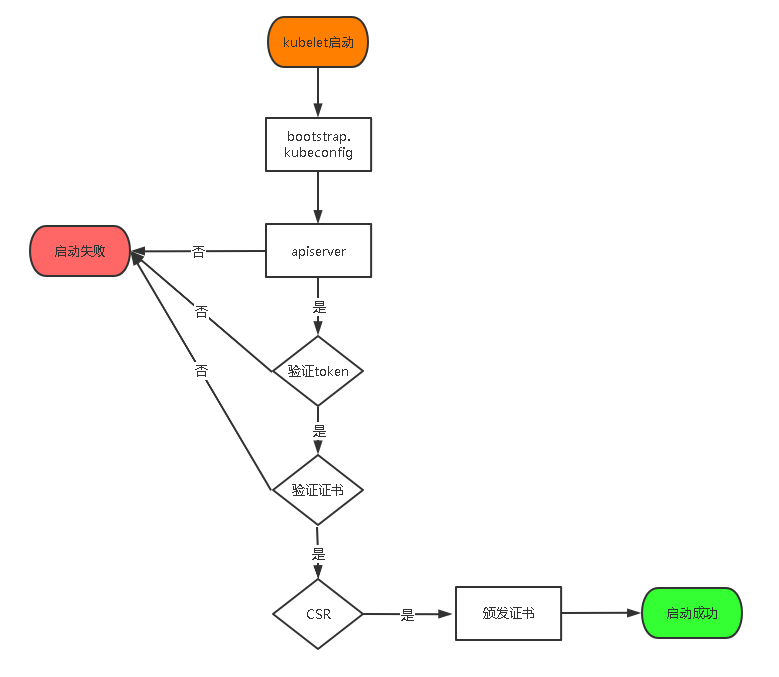

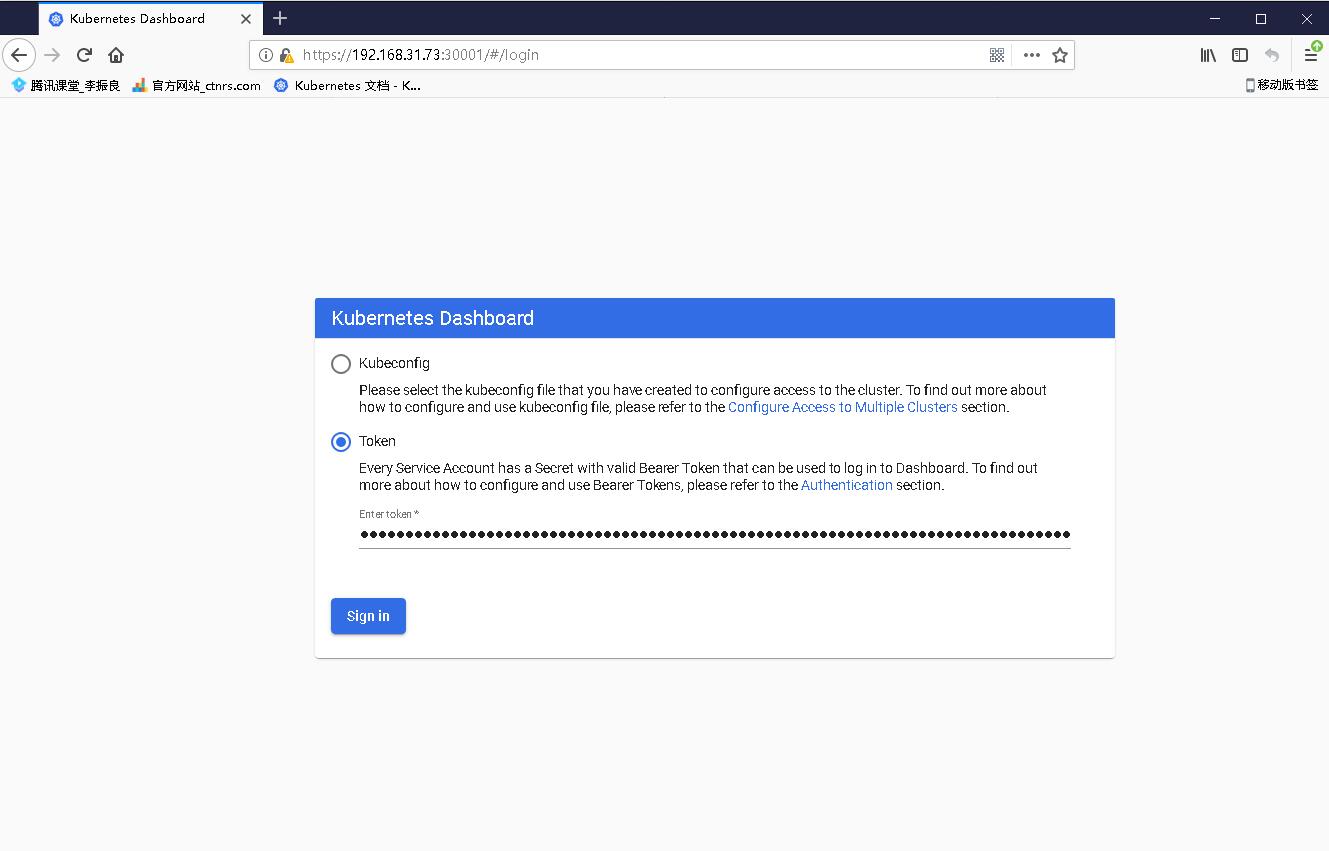

标签:fail 客户端访问 pen 发行版 原理 nslookup 高可用 开机启动 rap 目前生产部署Kubernetes集群主要有两种方式: Kubeadm是一个K8s部署工具,提供kubeadm init和kubeadm join,用于快速部署Kubernetes集群。 官方地址:https://kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/ 从github下载发行版的二进制包,手动部署每个组件,组成Kubernetes集群。 Kubeadm降低部署门槛,但屏蔽了很多细节,遇到问题很难排查。如果想更容易可控,推荐使用二进制包部署Kubernetes集群,虽然手动部署麻烦点,期间可以学习很多工作原理,也利于后期维护。 在开始之前,部署Kubernetes集群机器需要满足以下几个条件: 软件环境: 服务器整体规划: 须知:考虑到有些朋友电脑配置较低,这么多虚拟机跑不动,所以这一套高可用集群分两部分实施,先部署一套单Master架构(192.168.31.71/72/73),再扩容为多Master架构(上述规划),顺便熟悉下Master扩容流程。 单Master架构图: 单Master服务器规划: Etcd 是一个分布式键值存储系统,Kubernetes使用Etcd进行数据存储,所以先准备一个Etcd数据库,为解决Etcd单点故障,应采用集群方式部署,这里使用3台组建集群,可容忍1台机器故障,当然,你也可以使用5台组建集群,可容忍2台机器故障。 注:为了节省机器,这里与K8s节点机器复用。也可以独立于k8s集群之外部署,只要apiserver能连接到就行。 cfssl是一个开源的证书管理工具,使用json文件生成证书,相比openssl更方便使用。 找任意一台服务器操作,这里用Master节点。 创建工作目录: 自签CA: 生成证书: 创建证书申请文件: 注:上述文件hosts字段中IP为所有etcd节点的集群内部通信IP,一个都不能少!为了方便后期扩容可以多写几个预留的IP。 生成证书: 下载地址:https://github.com/etcd-io/etcd/releases/download/v3.4.9/etcd-v3.4.9-linux-amd64.tar.gz 以下在节点1上操作,为简化操作,待会将节点1生成的所有文件拷贝到节点2和节点3. 把刚才生成的证书拷贝到配置文件中的路径: 然后在节点2和节点3分别修改etcd.conf配置文件中的节点名称和当前服务器IP: 最后启动etcd并设置开机启动,同上。 如果输出上面信息,就说明集群部署成功。如果有问题第一步先看日志:/var/log/message 或 journalctl -u etcd 下载地址:https://download.docker.com/linux/static/stable/x86_64/docker-19.03.9.tgz 以下在所有节点操作。这里采用二进制安装,用yum安装也一样。 如果你在学习中遇到问题或者文档有误可联系阿良~ 微信: init1024 生成证书: 创建证书申请文件: 注:上述文件hosts字段中IP为所有Master/LB/VIP IP,一个都不能少!为了方便后期扩容可以多写几个预留的IP。 生成证书: 下载地址: https://github.com/kubernetes/kubernetes/blob/master/CHANGELOG/CHANGELOG-1.18.md#v1183 注:打开链接你会发现里面有很多包,下载一个server包就够了,包含了Master和Worker Node二进制文件。 注:上面两个\ \ 第一个是转义符,第二个是换行符,使用转义符是为了使用EOF保留换行符。 把刚才生成的证书拷贝到配置文件中的路径: TLS Bootstraping:Master apiserver启用TLS认证后,Node节点kubelet和kube-proxy要与kube-apiserver进行通信,必须使用CA签发的有效证书才可以,当Node节点很多时,这种客户端证书颁发需要大量工作,同样也会增加集群扩展复杂度。为了简化流程,Kubernetes引入了TLS bootstraping机制来自动颁发客户端证书,kubelet会以一个低权限用户自动向apiserver申请证书,kubelet的证书由apiserver动态签署。所以强烈建议在Node上使用这种方式,目前主要用于kubelet,kube-proxy还是由我们统一颁发一个证书。 TLS bootstraping 工作流程: 创建上述配置文件中token文件: 格式:token,用户名,UID,用户组 token也可自行生成替换: 所有组件都已经启动成功,通过kubectl工具查看当前集群组件状态: 如上输出说明Master节点组件运行正常。 如果你在学习中遇到问题或者文档有误可联系阿良~ 微信: init1024 下面还是在Master Node上操作,即同时作为Worker Node 在所有worker node创建工作目录: 从master节点拷贝: 拷贝到配置文件路径: 注:由于网络插件还没有部署,节点会没有准备就绪 NotReady 生成kube-proxy证书: 生成kubeconfig文件: 拷贝到配置文件指定路径: 先准备好CNI二进制文件: 下载地址:https://github.com/containernetworking/plugins/releases/download/v0.8.6/cni-plugins-linux-amd64-v0.8.6.tgz 解压二进制包并移动到默认工作目录: 部署CNI网络: 默认镜像地址无法访问,修改为docker hub镜像仓库。 部署好网络插件,Node准备就绪。 在master节点将Worker Node涉及文件拷贝到新节点192.168.31.72/73 注:这几个文件是证书申请审批后自动生成的,每个Node不同,必须删除重新生成。 Node2(192.168.31.73 )节点同上。记得修改主机名! 默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部: 访问地址:https://NodeIP:30001 创建service account并绑定默认cluster-admin管理员集群角色: 使用输出的token登录Dashboard。 CoreDNS用于集群内部Service名称解析。 DNS解析测试: 解析没问题。 至此,单Master集群部署完成,下一篇扩容为多Master集群~ 部署一套完整的Kubernetes高可用集群(二进制,最新版v1.18)上 标签:fail 客户端访问 pen 发行版 原理 nslookup 高可用 开机启动 rap 原文地址:https://blog.51cto.com/lizhenliang/2500242

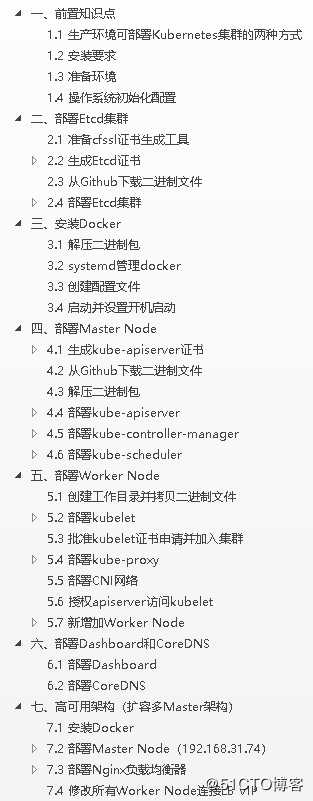

一、前置知识点

1.1 生产环境可部署Kubernetes集群的两种方式

1.2 安装要求

1.3 准备环境

软件

版本

操作系统

CentOS7.8_x64 (mini)

Docker

19-ce

Kubernetes

1.18

角色

IP

组件

k8s-master1

192.168.31.71

kube-apiserver,kube-controller-manager,kube-scheduler,etcd

k8s-master2

192.168.31.74

kube-apiserver,kube-controller-manager,kube-scheduler

k8s-node1

192.168.31.72

kubelet,kube-proxy,docker etcd

k8s-node2

192.168.31.73

kubelet,kube-proxy,docker,etcd

Load Balancer(Master)

192.168.31.81 ,192.168.31.88 (VIP)

Nginx L4

Load Balancer(Backup)

192.168.31. 82

Nginx L4

角色

IP

组件

k8s-master

192.168.31.71

kube-apiserver,kube-controller-manager,kube-scheduler,etcd

k8s-node1

192.168.31.72

kubelet,kube-proxy,docker etcd

k8s-node2

192.168.31.73

kubelet,kube-proxy,docker,etcd

1.4 操作系统初始化配置

# 关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

# 关闭selinux

sed -i ‘s/enforcing/disabled/‘ /etc/selinux/config # 永久

setenforce 0 # 临时

# 关闭swap

swapoff -a # 临时

sed -ri ‘s/.*swap.*/#&/‘ /etc/fstab # 永久

# 根据规划设置主机名

hostnamectl set-hostname 二、部署Etcd集群

节点名称

IP

etcd-1

192.168.31.71

etcd-2

192.168.31.72

etcd-3

192.168.31.73

2.1 准备cfssl证书生成工具

wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64

chmod +x cfssl_linux-amd64 cfssljson_linux-amd64 cfssl-certinfo_linux-amd64

mv cfssl_linux-amd64 /usr/local/bin/cfssl

mv cfssljson_linux-amd64 /usr/local/bin/cfssljson

mv cfssl-certinfo_linux-amd64 /usr/bin/cfssl-certinfo2.2 生成Etcd证书

1. 自签证书颁发机构(CA)

mkdir -p ~/TLS/{etcd,k8s}

cd TLS/etcdcat > ca-config.json ca-csr.json cfssl gencert -initca ca-csr.json | cfssljson -bare ca -

ls *pem

ca-key.pem ca.pem2. 使用自签CA签发Etcd HTTPS证书

cat > server-csr.json

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=www server-csr.json | cfssljson -bare server

ls server*pem

server-key.pem server.pem2.3 从Github下载二进制文件

2.4 部署Etcd集群

1. 创建工作目录并解压二进制包

mkdir /opt/etcd/{bin,cfg,ssl} -p

tar zxvf etcd-v3.4.9-linux-amd64.tar.gz

mv etcd-v3.4.9-linux-amd64/{etcd,etcdctl} /opt/etcd/bin/2. 创建etcd配置文件

cat > /opt/etcd/cfg/etcd.conf

3. systemd管理etcd

cat > /usr/lib/systemd/system/etcd.service 4. 拷贝刚才生成的证书

cp ~/TLS/etcd/ca*pem ~/TLS/etcd/server*pem /opt/etcd/ssl/5. 启动并设置开机启动

systemctl daemon-reload

systemctl start etcd

systemctl enable etcd6. 将上面节点1所有生成的文件拷贝到节点2和节点3

scp -r /opt/etcd/ root@192.168.31.72:/opt/

scp /usr/lib/systemd/system/etcd.service root@192.168.31.72:/usr/lib/systemd/system/

scp -r /opt/etcd/ root@192.168.31.73:/opt/

scp /usr/lib/systemd/system/etcd.service root@192.168.31.73:/usr/lib/systemd/system/vi /opt/etcd/cfg/etcd.conf

#[Member]

ETCD_NAME="etcd-1" # 修改此处,节点2改为etcd-2,节点3改为etcd-3

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.31.71:2380" # 修改此处为当前服务器IP

ETCD_LISTEN_CLIENT_URLS="https://192.168.31.71:2379" # 修改此处为当前服务器IP

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.31.71:2380" # 修改此处为当前服务器IP

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.31.71:2379" # 修改此处为当前服务器IP

ETCD_INITIAL_CLUSTER="etcd-1=https://192.168.31.71:2380,etcd-2=https://192.168.31.72:2380,etcd-3=https://192.168.31.73:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"7. 查看集群状态

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://192.168.31.71:2379,https://192.168.31.72:2379,https://192.168.31.73:2379" endpoint health

https://192.168.31.71:2379 is healthy: successfully committed proposal: took = 8.154404ms

https://192.168.31.73:2379 is healthy: successfully committed proposal: took = 9.044117ms

https://192.168.31.72:2379 is healthy: successfully committed proposal: took = 10.000825ms三、安装Docker

3.1 解压二进制包

tar zxvf docker-19.03.9.tgz

mv docker/* /usr/bin3.2 systemd管理docker

cat > /usr/lib/systemd/system/docker.service 3.3 创建配置文件

mkdir /etc/docker

cat > /etc/docker/daemon.json

3.4 启动并设置开机启动

systemctl daemon-reload

systemctl start docker

systemctl enable docker四、部署Master Node

4.1 生成kube-apiserver证书

1. 自签证书颁发机构(CA)

cat > ca-config.json ca-csr.json cfssl gencert -initca ca-csr.json | cfssljson -bare ca -

ls *pem

ca-key.pem ca.pem2. 使用自签CA签发kube-apiserver HTTPS证书

cd TLS/k8s

cat > server-csr.json

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=kubernetes server-csr.json | cfssljson -bare server

ls server*pem

server-key.pem server.pem4.2 从Github下载二进制文件

4.3 解压二进制包

mkdir -p /opt/kubernetes/{bin,cfg,ssl,logs}

tar zxvf kubernetes-server-linux-amd64.tar.gz

cd kubernetes/server/bin

cp kube-apiserver kube-scheduler kube-controller-manager /opt/kubernetes/bin

cp kubectl /usr/bin/4.4 部署kube-apiserver

1. 创建配置文件

cat > /opt/kubernetes/cfg/kube-apiserver.conf

2. 拷贝刚才生成的证书

cp ~/TLS/k8s/ca*pem ~/TLS/k8s/server*pem /opt/kubernetes/ssl/3. 启用 TLS Bootstrapping 机制

cat > /opt/kubernetes/cfg/token.csv head -c 16 /dev/urandom | od -An -t x | tr -d ‘ ‘4. systemd管理apiserver

cat > /usr/lib/systemd/system/kube-apiserver.service 5. 启动并设置开机启动

systemctl daemon-reload

systemctl start kube-apiserver

systemctl enable kube-apiserver6. 授权kubelet-bootstrap用户允许请求证书

kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap4.5 部署kube-controller-manager

1. 创建配置文件

cat > /opt/kubernetes/cfg/kube-controller-manager.conf

2. systemd管理controller-manager

cat > /usr/lib/systemd/system/kube-controller-manager.service 3. 启动并设置开机启动

systemctl daemon-reload

systemctl start kube-controller-manager

systemctl enable kube-controller-manager4.6 部署kube-scheduler

1. 创建配置文件

cat > /opt/kubernetes/cfg/kube-scheduler.conf

2. systemd管理scheduler

cat > /usr/lib/systemd/system/kube-scheduler.service 3. 启动并设置开机启动

systemctl daemon-reload

systemctl start scheduler

systemctl enable scheduler4. 查看集群状态

kubectl get cs

NAME STATUS MESSAGE ERROR

scheduler Healthy ok

controller-manager Healthy ok

etcd-2 Healthy {"health":"true"}

etcd-1 Healthy {"health":"true"}

etcd-0 Healthy {"health":"true"} 五、部署Worker Node

5.1 创建工作目录并拷贝二进制文件

mkdir -p /opt/kubernetes/{bin,cfg,ssl,logs} cd kubernetes/server/bin

cp kubelet kube-proxy /opt/kubernetes/bin # 本地拷贝5.2 部署kubelet

1. 创建配置文件

cat > /opt/kubernetes/cfg/kubelet.conf

2. 配置参数文件

cat > /opt/kubernetes/cfg/kubelet-config.yml 3. 生成bootstrap.kubeconfig文件

KUBE_APISERVER="https://192.168.31.71:6443" # apiserver IP:PORT

TOKEN="c47ffb939f5ca36231d9e3121a252940" # 与token.csv里保持一致

# 生成 kubelet bootstrap kubeconfig 配置文件

kubectl config set-cluster kubernetes --certificate-authority=/opt/kubernetes/ssl/ca.pem --embed-certs=true --server=${KUBE_APISERVER} --kubeconfig=bootstrap.kubeconfig

kubectl config set-credentials "kubelet-bootstrap" --token=${TOKEN} --kubeconfig=bootstrap.kubeconfig

kubectl config set-context default --cluster=kubernetes --user="kubelet-bootstrap" --kubeconfig=bootstrap.kubeconfig

kubectl config use-context default --kubeconfig=bootstrap.kubeconfigcp bootstrap.kubeconfig /opt/kubernetes/cfg4. systemd管理kubelet

cat > /usr/lib/systemd/system/kubelet.service 5. 启动并设置开机启动

systemctl daemon-reload

systemctl start kubelet

systemctl enable kubelet5.3 批准kubelet证书申请并加入集群

# 查看kubelet证书请求

kubectl get csr

NAME AGE SIGNERNAME REQUESTOR CONDITION

node-csr-uCEGPOIiDdlLODKts8J658HrFq9CZ--K6M4G7bjhk8A 6m3s kubernetes.io/kube-apiserver-client-kubelet kubelet-bootstrap Pending

# 批准申请

kubectl certificate approve node-csr-uCEGPOIiDdlLODKts8J658HrFq9CZ--K6M4G7bjhk8A

# 查看节点

kubectl get node

NAME STATUS ROLES AGE VERSION

k8s-master NotReady

5.4 部署kube-proxy

1. 创建配置文件

cat > /opt/kubernetes/cfg/kube-proxy.conf 2. 配置参数文件

cat > /opt/kubernetes/cfg/kube-proxy-config.yml 3. 生成kube-proxy.kubeconfig文件

# 切换工作目录

cd TLS/k8s

# 创建证书请求文件

cat > kube-proxy-csr.json KUBE_APISERVER="https://192.168.31.71:6443"

kubectl config set-cluster kubernetes --certificate-authority=/opt/kubernetes/ssl/ca.pem --embed-certs=true --server=${KUBE_APISERVER} --kubeconfig=kube-proxy.kubeconfig

kubectl config set-credentials kube-proxy --client-certificate=./kube-proxy.pem --client-key=./kube-proxy-key.pem --embed-certs=true --kubeconfig=kube-proxy.kubeconfig

kubectl config set-context default --cluster=kubernetes --user=kube-proxy --kubeconfig=kube-proxy.kubeconfig

kubectl config use-context default --kubeconfig=kube-proxy.kubeconfigcp kube-proxy.kubeconfig /opt/kubernetes/cfg/4. systemd管理kube-proxy

cat > /usr/lib/systemd/system/kube-proxy.service 5. 启动并设置开机启动

systemctl daemon-reload

systemctl start kube-proxy

systemctl enable kube-proxy5.5 部署CNI网络

mkdir /opt/cni/bin

tar zxvf cni-plugins-linux-amd64-v0.8.6.tgz -C /opt/cni/binwget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

sed -i -r "s#quay.io/coreos/flannel:.*-amd64#lizhenliang/flannel:v0.12.0-amd64#g" kube-flannel.ymlkubectl apply -f kube-flannel.yml

kubectl get pods -n kube-system

NAME READY STATUS RESTARTS AGE

kube-flannel-ds-amd64-2pc95 1/1 Running 0 72s

kubectl get node

NAME STATUS ROLES AGE VERSION

k8s-master Ready 5.6 授权apiserver访问kubelet

cat > apiserver-to-kubelet-rbac.yaml 5.7 新增加Worker Node

1. 拷贝已部署好的Node相关文件到新节点

scp /opt/kubernetes root@192.168.31.72:/opt/

scp -r /usr/lib/systemd/system/{kubelet,kube-proxy}.service root@192.168.31.72:/usr/lib/systemd/system

scp -r /opt/cni/ root@192.168.31.72:/opt/

scp /opt/kubernetes/ssl/ca.pem root@192.168.31.72:/opt/kubernetes/ssl2. 删除kubelet证书和kubeconfig文件

rm /opt/kubernetes/cfg/kubelet.kubeconfig

rm -f /opt/kubernetes/ssl/kubelet*

3. 修改主机名

vi /opt/kubernetes/cfg/kubelet.conf

--hostname-override=k8s-node1

vi /opt/kubernetes/cfg/kube-proxy-config.yml

hostnameOverride: k8s-node14. 启动并设置开机启动

systemctl daemon-reload

systemctl start kubelet

systemctl enable kubelet

systemctl start kube-proxy

systemctl enable kube-proxy5. 在Master上批准新Node kubelet证书申请

kubectl get csr

NAME AGE SIGNERNAME REQUESTOR CONDITION

node-csr-4zTjsaVSrhuyhIGqsefxzVoZDCNKei-aE2jyTP81Uro 89s kubernetes.io/kube-apiserver-client-kubelet kubelet-bootstrap Pending

kubectl certificate approve node-csr-4zTjsaVSrhuyhIGqsefxzVoZDCNKei-aE2jyTP81Uro6. 查看Node状态

kubectl get node

NAME STATUS ROLES AGE VERSION

k8s-master Ready 六、部署Dashboard和CoreDNS

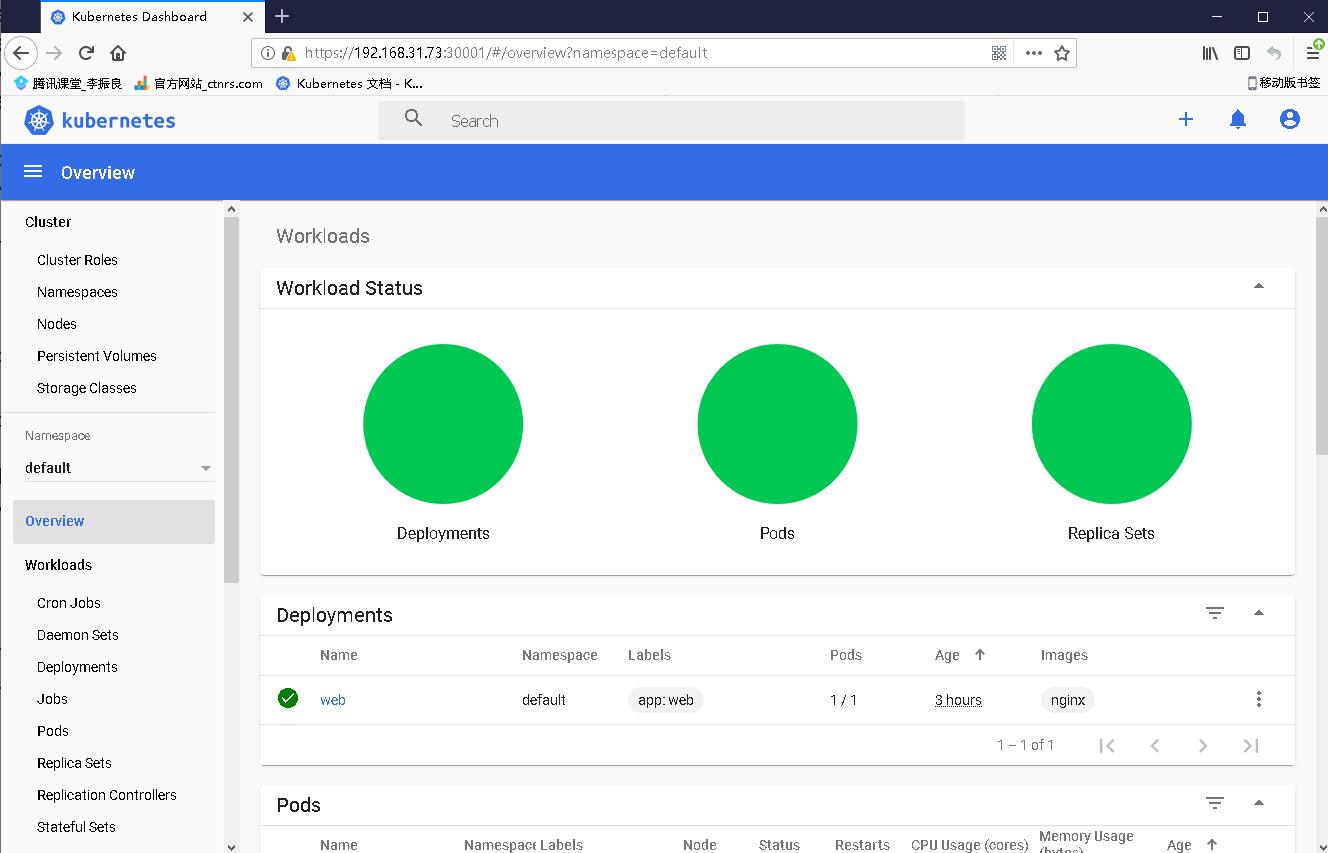

6.1 部署Dashboard

$ wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.0-beta8/aio/deploy/recommended.yamlvi recommended.yaml

kind: Service

apiVersion: v1

metadata:

labels:

k8s-app: kubernetes-dashboard

name: kubernetes-dashboard

namespace: kubernetes-dashboard

spec:

ports:

- port: 443

targetPort: 8443

nodePort: 30001

type: NodePort

selector:

k8s-app: kubernetes-dashboard

kubectl apply -f recommended.yamlkubectl get pods,svc -n kubernetes-dashboard

NAME READY STATUS RESTARTS AGE

pod/dashboard-metrics-scraper-694557449d-z8gfb 1/1 Running 0 2m18s

pod/kubernetes-dashboard-9774cc786-q2gsx 1/1 Running 0 2m19s

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/dashboard-metrics-scraper ClusterIP 10.0.0.141 kubectl create serviceaccount dashboard-admin -n kube-system

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk ‘/dashboard-admin/{print $1}‘)

6.2 部署CoreDNS

kubectl apply -f coredns.yaml

kubectl get pods -n kube-system

NAME READY STATUS RESTARTS AGE

coredns-5ffbfd976d-j6shb 1/1 Running 0 32s

kube-flannel-ds-amd64-2pc95 1/1 Running 0 38m

kube-flannel-ds-amd64-7qhdx 1/1 Running 0 15m

kube-flannel-ds-amd64-99cr8 1/1 Running 0 26mkubectl run -it --rm dns-test --image=busybox:1.28.4 sh

If you don‘t see a command prompt, try pressing enter.

/ # nslookup kubernetes

Server: 10.0.0.2

Address 1: 10.0.0.2 kube-dns.kube-system.svc.cluster.local

Name: kubernetes

Address 1: 10.0.0.1 kubernetes.default.svc.cluster.local

文章标题:部署一套完整的Kubernetes高可用集群(二进制,最新版v1.18)上

文章链接:http://soscw.com/index.php/essay/54674.html