朴素贝叶斯算法(python)

2021-02-16 00:18

标签:就是 ram red params http 缺点 partial margin 高斯分布 朴素贝叶斯算法 优点: 缺点: 适用数据类型:离散型数据。 朴素贝叶斯假设:数据集属性之间是相互独立的,即独立同分布。 朴素贝叶斯的思想基础是这样的: 对于给出的待分类项,求解在此项出现的条件下各个类别出现的概率,哪个最大,就认为此待分类项属于哪个类别。 这三个类适用的分类场景各不相同,一般来说,如果样本特征的分布大部分是连续值,使用GaussianNB会比较好。如果如果样本特征的分大部分是多元离散值,使用MultinomialNB比较合适。而如果样本特征是二元离散值或者很稀疏的多元离散值,应该使用BernoulliNB。 sklearn 提供了朴素贝叶斯算法的实现类,用于多项模型 sklearn.naive_bayes. 类方法 朴素贝叶斯算法(python) 标签:就是 ram red params http 缺点 partial margin 高斯分布 原文地址:https://www.cnblogs.com/xiao02fang/p/12712008.html

使用 sklearn 实现朴素贝叶斯算法

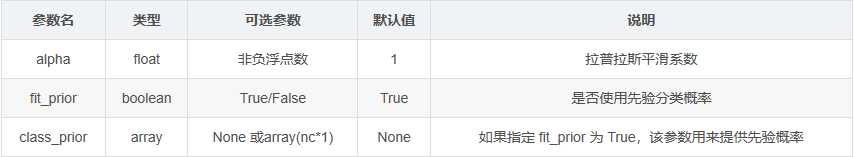

MultinomialNB(alpha=1.0, fit_prior=True, class_prior=None)

下面的列表中,我们将分类数称为 nc,将特征数称为 nf。

sklearn.naive_bayes.MultinomialNB 类构造参数

get_params([deep]) – 获取参数

set_params(**params) – 设置参数

partial_fit(X, y[, classes, sample_weight]) – 部分样本上的增量拟合

predict(X) – 预测

predict_log_proba(X) – 返回测试向量X的对数概率估计

predict_proba(X) – 返回测试向量X的概率估计

score(X, y[, sample_weight]) – 返回模型的平均精度

原文链接:https://blog.csdn.net/DILIGENT203/article/details/83934809

上一篇:Python基础语法

下一篇:【Java】步入OOP 面向对象