Python爬虫实战:爬取淘女郎照片

2021-04-07 10:26

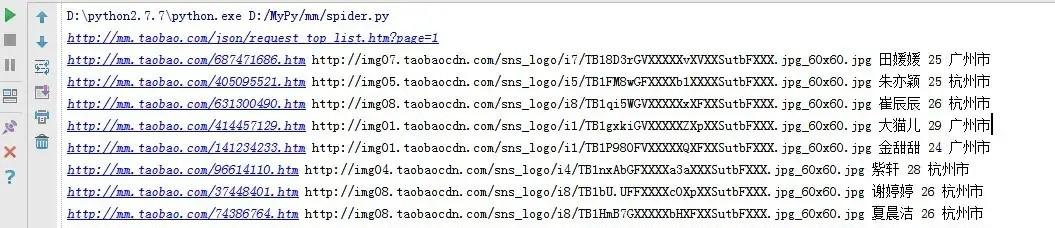

标签:items 姓名 exist 处理 sub += close 管理 file PS:如有需要Python学习资料的小伙伴可以加下方的群去找免费管理员领取 在这里我们用到的URL是 http://mm.taobao.com/json/request_top_list.htm?page=1,问号前面是基地址,后面的参数page是代表第几页,可以随意更换地址。点击开之后,会发现有一些淘宝MM的简介,并附有超链接链接到个人详情页面。 我们需要抓取本页面的头像地址,MM姓名,MM年龄,MM居住地,以及MM的个人详情页面地址。 相信大家经过上几次的实战,对抓取和提取页面的地址已经非常熟悉了,这里没有什么难度了,我们首先抓取本页面的MM详情页面地址,姓名,年龄等等的信息打印出来,直接贴代码如下 运行结果如下 在这里,我们有写入图片和写入文本两种方式 1)写入图片 2)写入文本 3)创建新目录 主要的知识点已经在前面都涉及到了,如果大家前面的章节都已经看了,完成这个爬虫不在话下,具体的详情在此不再赘述,直接帖代码啦。 spider.py本篇目标

1.URL的格式

2.抓取简要信息

import urllib

import urllib2

import re

class Spider:

def __init__(self):

self.siteURL = ‘http://mm.taobao.com/json/request_top_list.htm‘

def getPage(self,pageIndex):

url = self.siteURL + "?page=" + str(pageIndex)

print url

request = urllib2.Request(url)

response = urllib2.urlopen(request)

return response.read().decode(‘gbk‘)

def getContents(self,pageIndex):

page = self.getPage(pageIndex)

pattern = re.compile(‘

3.文件写入简介

#传入图片地址,文件名,保存单张图片

def saveImg(self,imageURL,fileName):

u = urllib.urlopen(imageURL)

data = u.read()

f = open(fileName, ‘wb‘)

f.write(data)

f.close()

def saveBrief(self,content,name):

fileName = name + "/" + name + ".txt"

f = open(fileName,"w+")

print u"正在偷偷保存她的个人信息为",fileName

f.write(content.encode(‘utf-8‘))

#创建新目录

def mkdir(self,path):

path = path.strip()

# 判断路径是否存在

# 存在 True

# 不存在 False

isExists=os.path.exists(path)

# 判断结果

if not isExists:

# 如果不存在则创建目录

# 创建目录操作函数

os.makedirs(path)

return True

else:

# 如果目录存在则不创建,并提示目录已存在

return False

4.代码完善

import urllib

import urllib2

import re

import tool

import os

#抓取MM

class Spider:

#页面初始化

def __init__(self):

self.siteURL = ‘http://mm.taobao.com/json/request_top_list.htm‘

self.tool = tool.Tool()

#获取索引页面的内容

def getPage(self,pageIndex):

url = self.siteURL + "?page=" + str(pageIndex)

request = urllib2.Request(url)

response = urllib2.urlopen(request)

return response.read().decode(‘gbk‘)

#获取索引界面所有MM的信息,list格式

def getContents(self,pageIndex):

page = self.getPage(pageIndex)

pattern = re.compile(‘

下一篇:Java进阶--Set接口

文章标题:Python爬虫实战:爬取淘女郎照片

文章链接:http://soscw.com/index.php/essay/72346.html