lucene&solr全文检索_4改进

2021-04-21 16:27

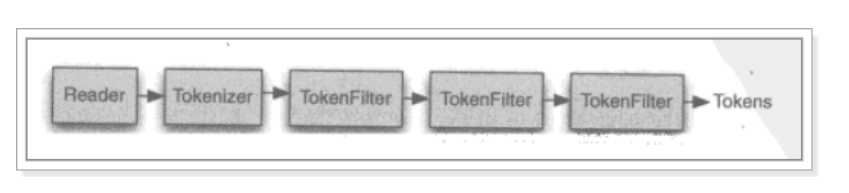

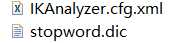

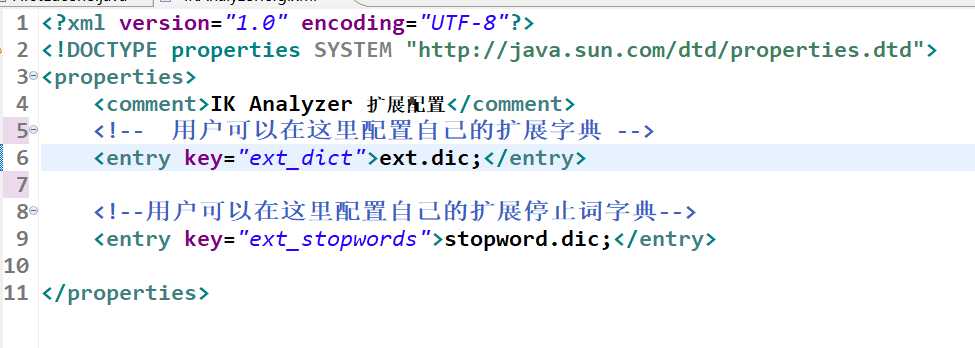

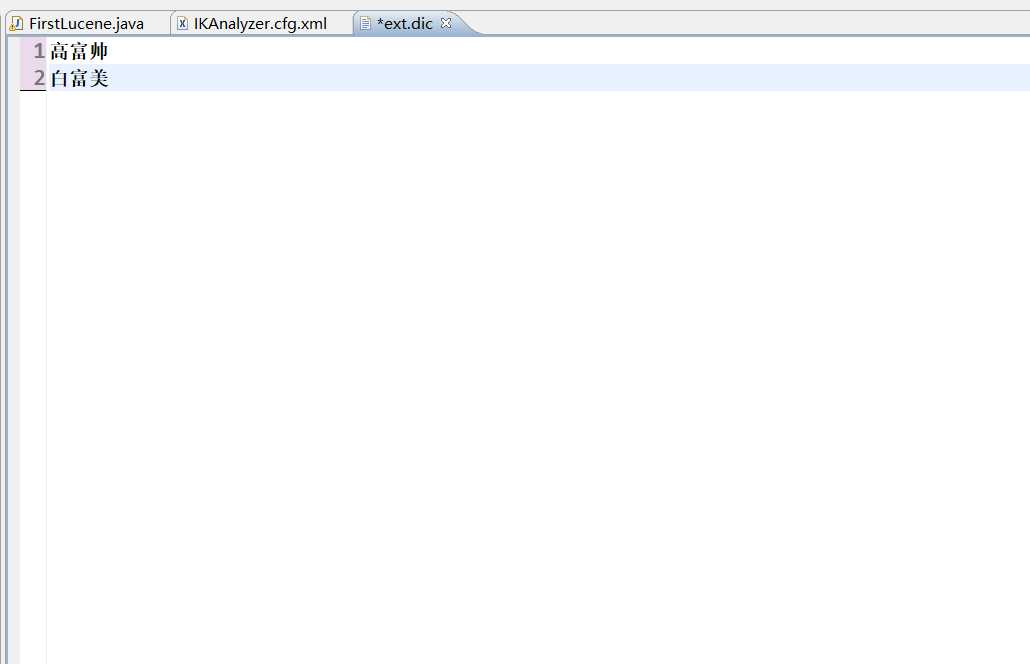

标签:大写 dict 维护 下载 font nbsp 二分法 ade 现在 在之前的程序中我们发现分词不太准确,因此我们可以使用支持中文分词。 分析器的执行过程: 从一个reader字符流开始,创建一个基于reader的tokenizer分词器,经过三个tokenfilter(第一个大写变小写,第二个用回车替换空格,去掉不需要的a,the,and,逗号等)生成tokens。要看分析器的分析效果只需要看tokenstream中的内容就可以了,每个分析器都有一个方法tokenstream,返回一个tokenstream对象。 lucene自带中文分析器: standardAnalyzer:单字分词即一个一个分 CJKAnalyzer:二分法,即两个一分,、 SmartChineseAnalyzer:对中文支持好,但扩展性差,对词库的操作不是很好处理。 由此可见上面三个分析器效果并不是很理想,因此要使用第三方分析器: 我们使用IKanalyzer,需要导入jar包: 同时你可以在xml文件中扩展 扩展的内容在ext.dic中(可以复制stopword.dic然后删除内容,重新输入自己想要扩展的内容)例如在ext.dic中加入高富帅白富美等 打开stopword.dic,即分析之后删除的文字。 注意无论使用什么分析器,都要注意搜索使用的分析器要和索引使用的分析器一致。 lucene&solr全文检索_4改进 标签:大写 dict 维护 下载 font nbsp 二分法 ade 现在 原文地址:https://www.cnblogs.com/tkg1314/p/12249934.html

,并将核心文件放入src中

,并将核心文件放入src中 ,然后就可以使用了。

,然后就可以使用了。

文章标题:lucene&solr全文检索_4改进

文章链接:http://soscw.com/index.php/essay/77681.html