scrapyd和scrapydweb使用详细教程

2021-05-11 00:29

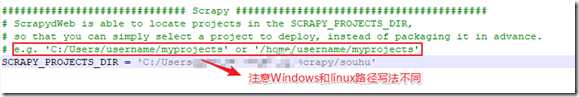

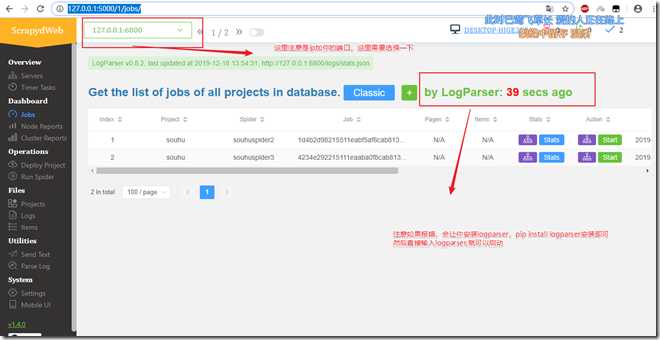

标签:schedule 地址 deploy round play alt blob 地方 pre 一个爬虫框架,你可以创建一个scrapy项目 相当于一个组件,能够将scrapy项目进行远程部署,调度使用等 因此scrapyd可以看作一个cs(client-server)程序,因此毫无疑问我们需要安装和配置scrapyd(server) 和连接的scrapy-client(client) 是一个基于scrapyd的可视化组件,集成并且提供更多可视化功能和更优美的界面 总结:三者如同葫芦套娃,总共三层 这里我就不细说了,很多很好的博客,这里贴一篇 参照:https://www.cnblogs.com/fengf233/p/11208975.html 安装完成后,在cmd中启动命令 在浏览器中输入:http://localhost:6800/,如果出现下面界面则表示启动成功(不要关闭cmd,后面步骤还需要) 打开scrapy项目,有个scrapy.cfg文件,按如下进行配置 将你的scrapy-deploy文件复制到与scrapy.cfg文件同一目录,scrapy-deploy文件位于你python环境下的scripts文件夹中 然后在cmd中进入你的scrapy项目目录,输入: 说明已经扫描到项目,接下来就是编译项目 编译完成后就是上传了,上传输入下面代码(默认为启动状态) (开源地址:https://github.com/my8100/files/blob/master/scrapydweb/README_CN.md) 运行(前提是scrapyd服务器必须处于运行状态) 如果出现下面可视化界面,表示安装成功 注意:如果出现6801端口无法连接,这个是因为你没有配置集群环境,不用担心 (基本上使用默认的就行,根据需要配置) 配置文件在你当前启动scrapydweb路径下,scrapydweb_settings_v10.py,只有两处需要配置。 ①第一处就是username和password,如果是远程的服务器的话,建议开启认证 ②第二处是项目路径(这里是scrapydweb比较方便的地方,不用事先将项目先上传到scrapyd服务器,scrapydweb能够帮我们上传) ①重启 ②开始可视化管理 scrapyd和scrapydweb使用详细教程 标签:schedule 地址 deploy round play alt blob 地方 pre 原文地址:https://www.cnblogs.com/gambler/p/12059541.htmlⅠ、首先要搞清楚几个概念

1、scrapy是什么?

2、scrapyd是什么?

3、scrapydweb是什么?

II、安装scrapy和创建一个scrapy项目

III、安装scrapyd和scrapyd-client和配置

1、安装

pip install scrapyd

pip install scrapy-client

scrapyd

2、配置

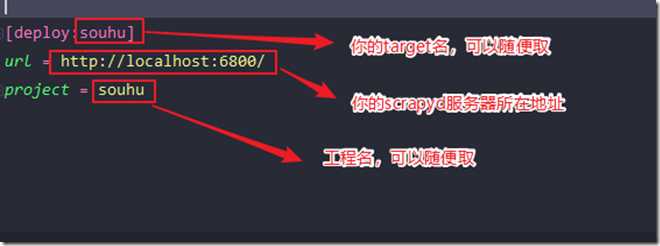

①配置scrapy项目

②上传scrapy项目

python scrapy-deploy –l

![]()

python scrapyd-deploy souhu -p souhu

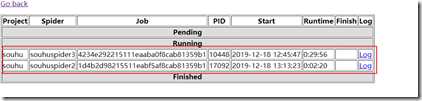

curl http://localhost:6800/schedule.json -d project=souhu -d spider=souhuspider3

![]()

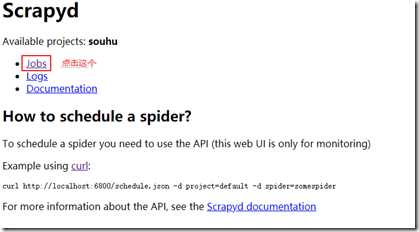

③、在server(http://localhost:6800/)进行检查,在jobs出现列表则表示上传成功

IV、安装scrapydweb

1、安装

pip install scrapydweb

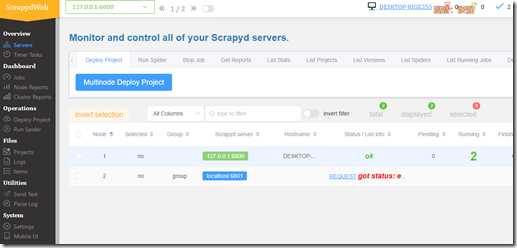

scrapyweb

![]()

2、配置

3、重启并开始管理

scrapydweb

文章标题:scrapyd和scrapydweb使用详细教程

文章链接:http://soscw.com/index.php/essay/84185.html