PYTHON_DAY_03

2020-12-13 03:55

标签:network 排名 point 本地 导入 text 获取数据 format 内容 今日内容: 2.互联网建立的目的? 3.什么是数据? 4.上网的全过程: - 爬虫程序: - 客户端: 客户端的ip和端口 ------> 服务端的 IP 和 端口 发送请求可以建立链接获取相应数据。 1.安装与使用 2.爬取视频 1)请求url(访问的网站地址) POST: 3) 响应状态码: 4) 请求头信息: 5)请求体: .*?: 非贪婪匹配 (.*?): 提取括号内的数据 电影排名、电影url、电影名称、导演-主演-类型、电影评分、评价人数、电影简介 01 requests基本使用 02 爬取视频 03 爬取豆瓣电影Top250 PYTHON_DAY_03 标签:network 排名 point 本地 导入 text 获取数据 format 内容 原文地址:https://www.cnblogs.com/hsfhf/p/11094642.html

一 爬虫原理

二 Requests请求库

一 爬虫原理

1.什么是互联网?

指的是由一堆网络设备,把一台台的计算机互联网到一起称之为互联网。

互联网建立的目的是为了数据的传递以及数据的共享。

例如淘宝、京东商品信息等...

东方财富、雪球网的一些证券投资信息...

链家、自如等房源信息....

12306的票务信息...

- 普通用户:

打开浏览器 ——> 往目标站点发送请求 ——> 获取响应数据 ——> 渲染到浏览器中

模拟浏览器 ——> 往目标站点发送请求 ——> 获取响应数据 ——> 提取有价值的数据 ——> 持久化到数据中

5.浏览器发送的是什么请求?

http协议的请求。

浏览器是一个软件 --> 客户端的 IP 和 端口

- 服务端

https://www.jd.com/

www.jd.com(京东域名)-> DNS解析 -> 京东服务端的 IP 和 端口

6.爬虫的全过程

- 发送请求 (需要请求库: Requests请求库、Selenium请求库)

- 获取响应数据 (只要往服务器发送请求,请求通过后会返回响应数据)

- 解析并提取数据(需要解析库: re、BeautifulSoup4、Xpath...)

- 保存到本地 (文件处理、数据库、MongoDB存储库)

二 Requests请求库

- 打开cmd

- 输入: pip3 install requests

3.抓包分析

打开浏览器的开发者模式(检查)----> 选中network

找到访问的页面后缀 xxx.html(响应文本)

2)请求方式:

GET:

直接发送请求获取数据

https://www.cnblogs.com/kermitjam/articles/9692597.html

需要携带用户信息往目标地址发送请求

https://www.cnblogs.com/login

2xx: 成功

3xx: 重定向

4xx: 找不到资源

5xx: 服务器错误

User-Agent: 用户代理(证明是通过电脑设备及浏览器发送的请求)

Cookies: 登录用户真实信息(证明你目标网站的用户)

Referer: 上一次访问的url (证明你是从目标网站跳转过来的)

POST请求才会有请求体。

Form Data

{

‘user‘: ‘tank‘,

‘pwd‘: ‘123‘

}

四 爬取豆瓣电影

.: 从当前位置开始

*: 查找所有

?: 找到第一个不找

.*: 贪婪匹配

.*?.*?(.*?)

.*?导演:(.*?).*?

.*?(.*?)人评价.*?(.*?)

226

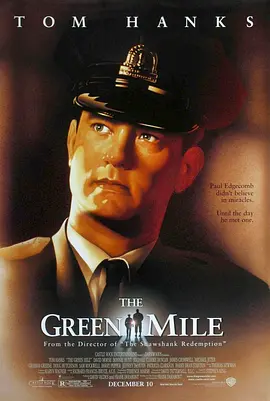

绿里奇迹

/ The Green Mile

/ 绿色奇迹(台) / 绿色英里

[可播放]

导演: Frank Darabont 主演: 汤姆·汉克斯 Tom Hanks / 大卫·摩斯 David M...

1999 / 美国 / 犯罪 剧情 奇幻 悬疑

141370人评价

天使暂时离开。

import requests # 导入requests请求库

# 往百度主页发送请求,获取响应对象

response = requests.get(url=‘https://www.baidu.com/‘)

# 设置字符编码为 utf-8

response.encoding = ‘utf-8‘

# 打印响应文本

print(response.text)

# 把响应文本写入本地

with open(‘baidu.html‘, ‘w‘, encoding=‘utf-8‘) as f:

f.write(response.text)

‘‘‘‘‘‘

‘‘‘

视频选项:

1.梨视频

‘‘‘

# import requests

#

# # 往视频源地址发送请求

# response = requests.get(

# ‘https://video.pearvideo.com/mp4/adshort/20190625/cont-1570302-14057031_adpkg-ad_hd.mp4‘)

#

# # 打印二进制流,比如图片、视频等数据

# print(response.content)

#

# # 保存视频到本地

# with open(‘视频.mp4‘, ‘wb‘) as f:

# f.write(response.content)

‘‘‘

1、先往梨视频主页发送请求

https://www.pearvideo.com/

解析获取所有视频的id:

video_1570302

re.findall()

2、获取视频详情页url:

惊险!男子抢上地铁滑倒,就脚进去了

https://www.pearvideo.com/video_1570302

揭秘坎儿井

https://www.pearvideo.com/video_1570107

‘‘‘

import requests

import re # 正则,用于解析文本数据

# 1、先往梨视频主页发送请求

response = requests.get(‘https://www.pearvideo.com/‘)

# print(response.text)

# re正则匹配获取所有视频id

# 参数1: 正则匹配规则

# 参数2: 解析文本

# 参数3: 匹配模式

res_list = re.findall(‘(.*?)‘, response.text, re.S)[0]

print(video_name)

# 往视频url发送请求获取视频二进制流

v_response = requests.get(video_url)

with open(‘%s.mp4‘ % video_name, ‘wb‘) as f:

f.write(v_response.content)

print(video_name, ‘视频爬取完成‘)

‘‘‘‘‘‘

‘‘‘

https://movie.douban.com/top250?start=0&filter=

https://movie.douban.com/top250?start=25&filter=

https://movie.douban.com/top250?start=50&filter=

1.发送请求

2.解析数据

3.保存数据

‘‘‘

import requests

import re

# 爬虫三部曲

# 1.发送请求

def get_page(base_url):

response = requests.get(base_url)

return response

# 2.解析文本

def parse_index(text):

res = re.findall(‘